VibeVoice 공개, 오픈소스 음성 AI가 Whisper 이후를 노린다

정확도 경쟁을 넘어서 장문 처리, 화자 분리, 배포 친화성이 새 기준이 되고 있다

나는 요즘 새 AI 모델 소식을 볼 때 데모보다 먼저 배포 경로를 본다. 멋진 음성 샘플은 많지만, 실제로 팀이 쓰는 순간 중요한 건 API 가격표보다 긴 음성을 얼마나 덜 자르고, 화자를 얼마나 덜 잃어버리고, 기존 파이프라인에 얼마나 쉽게 꽂히느냐이기 때문이다. 그런 기준으로 보면 Microsoft가 공개한 VibeVoice는 단순한 새 음성 모델이 아니라, Whisper 이후 오픈소스 음성 AI 경쟁의 기준을 다시 쓰려는 시도에 가깝다.

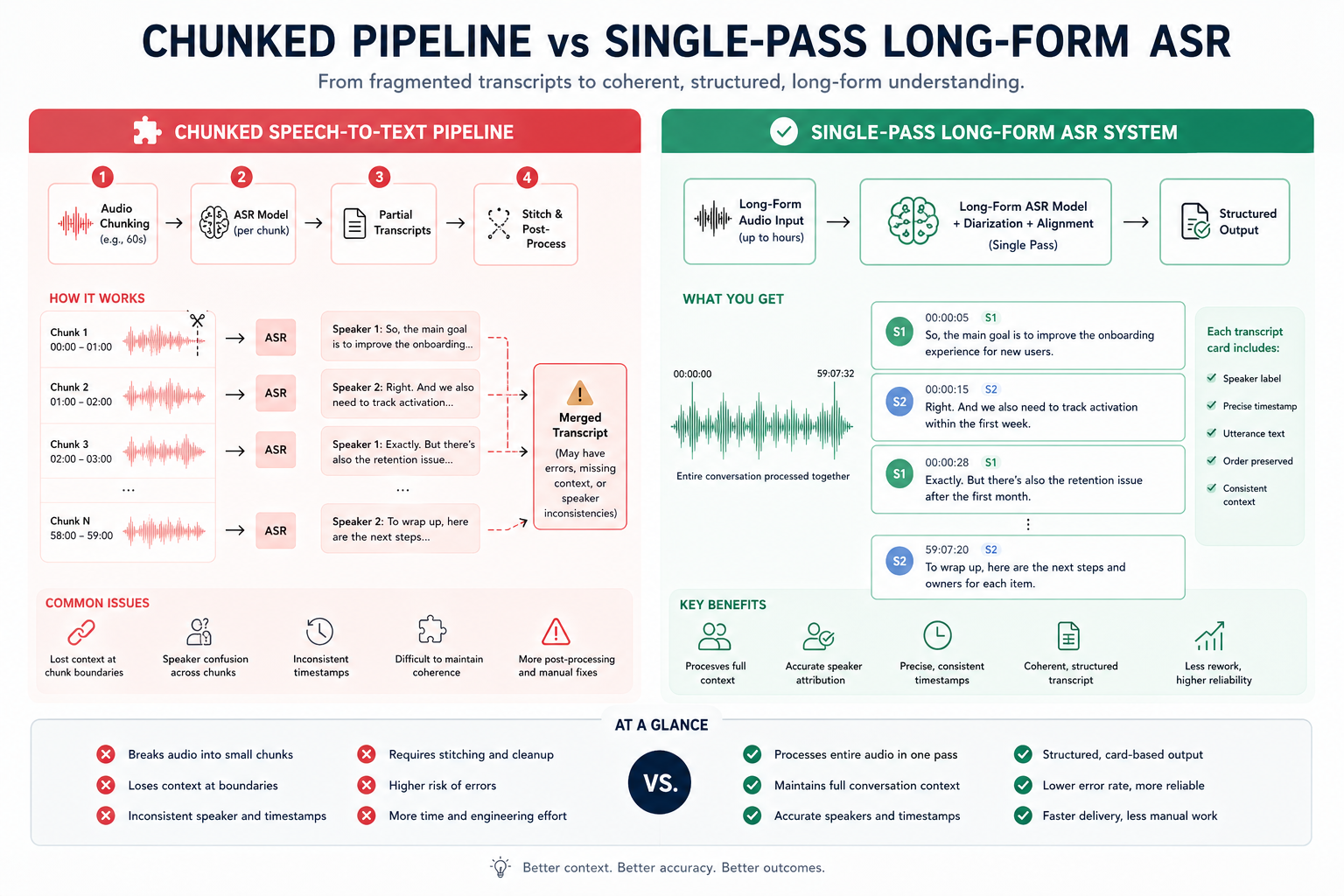

핵심은 명확하다. VibeVoice-ASR은 공식 문서 기준으로 최대 60분 길이의 오디오를 단일 패스(single pass)로 처리하고, 결과를 그냥 텍스트 한 덩어리로 뱉는 대신 누가(Who), 언제(When), 무엇을(What) 말했는지 구조화해 준다. 여기에 50개 이상 언어 지원, customized hotwords, Hugging Face Transformers 통합, vLLM 추론 지원까지 붙었다. 이 조합은 “좋은 STT 모델 하나 더 나왔다”보다 훨씬 큰 신호다.

Whisper 이후의 진짜 경쟁은 정확도 하나가 아니다

Whisper가 열어준 시장은 컸다. 음성 인식이 더 이상 대형 기업 전유물이 아니게 됐고, 자막 생성, 회의록, 인터뷰 정리, 유튜브 후처리 같은 흐름이 한꺼번에 열렸다. 그런데 실무에 넣어보면 금방 다음 문제가 튀어나온다.

- 긴 오디오를 잘게 쪼개며 맥락이 흐려진다

- 화자가 여러 명이면 누가 말했는지 정리가 번거롭다

- 도메인 용어, 사람 이름, 브랜드명이 자주 깨진다

- 후처리 파이프라인이 길어져서 운영 비용이 불어난다

VibeVoice-ASR은 바로 이 지점을 찌른다. 공식 docs/vibevoice-asr.md에 따르면 이 모델은 64K token length 안에서 최대 60분 연속 음성을 받아 처리하고, 단순 ASR이 아니라 diarization(화자 분리)과 timestamping을 함께 수행한다. 즉, 기존에 팀이 따로 붙이던 레이어를 모델 출력 단계에서 더 많이 흡수한다.

이건 생각보다 큰 차이다. 실무에서 음성 AI 비용은 모델 호출비보다 후처리 복잡도에서 자주 새기 때문이다. 긴 팟캐스트, 다자 회의, 상담 녹취처럼 사람이 실제로 남기는 데이터는 대부분 지저분하고 길다. 그런 데이터를 매번 chunk로 자르고, 다시 화자 분리하고, 타임스탬프를 맞추는 과정이 길어질수록 제품은 느려지고 운영은 피곤해진다.

VibeVoice가 지금 뜨는 이유는 모델보다 운영 친화성에 있다

내가 더 흥미롭게 본 건 성능 수치보다 배포 경로다. VibeVoice는 지금 음성 AI 쪽에서도 코딩 에이전트 시장과 비슷한 장면을 만든다. 경쟁 포인트가 “우리 모델이 더 똑똑하다”에서 끝나는 게 아니라, 누가 더 빨리 기존 워크플로우 안으로 들어오느냐로 이동하는 모습이다.

공식 README를 보면 흐름이 꽤 선명하다.

- 2026-01-21: VibeVoice-ASR 오픈소스 공개

- 2026-03-06: Hugging Face Transformers 릴리스에 통합

- finetuning guide 제공

- vLLM inference 지원 추가

이 순서는 중요하다. 공개만 하고 끝나는 연구 저장소가 아니라, 실험 → 통합 → 최적화 순으로 바로 운영 레이어를 붙이고 있기 때문이다. 특히 Transformers 통합은 한국 개발자 입장에서 의미가 크다. 새 프레임워크를 억지로 배우지 않아도 기존 Python/Hugging Face 습관 안에서 붙여볼 수 있다는 뜻이니까.

문서에 나온 가장 기본적인 실행 예시도 꽤 직관적이다.

python demo/vibevoice_asr_inference_from_file.py \ --model_path microsoft/VibeVoice-ASR \ --audio_files sample.wav이 정도 진입 장벽이면 연구팀만이 아니라, 콘텐츠 팀·툴팀·1인 개발자도 바로 손을 댈 수 있다. 결국 실제 확산을 만드는 건 벤치마크 한 줄보다 이런 배포 친화성이다.

한국 개발자에게는 ‘한국어 되나?‘보다 ‘운영이 줄어드나?‘가 더 중요하다

물론 한국어 지원은 중요하다. 다행히 VibeVoice-ASR 문서에는 한국어가 포함된 다국어 결과가 공개돼 있다. MLC-Challenge 표 기준으로 한국어는 DER 4.52, cpWER 15.35, tcpWER 16.07, WER 9.65가 적혀 있다. 이 수치만으로 모든 현장에 바로 최고라고 말할 수는 없지만, 적어도 “한국어는 나중 문제”인 프로젝트는 아니라는 뜻이다.

더 중요한 건 활용 장면이다. 한국 시장에서는 아래처럼 바로 상상이 된다.

- 유튜브/쇼츠 제작자: 장문 인터뷰나 라이브 녹음을 자막 초안 + 화자 분리까지 한 번에 뽑기

- B2B 상담/세일즈 팀: 상담 녹취를 화자별 회의록으로 정리하고 CRM 메모에 연결

- 에이전트 제품 팀: 음성 입력을 단순 텍스트가 아니라 구조화된 이벤트로 받아 후속 자동화에 연결

- 교육/스터디 커뮤니티: 여러 명이 섞여 말하는 세션 기록을 요약 가능한 텍스트 자산으로 전환

여기서 포인트는 STT 정확도 자체보다 후속 액션 친화성이다. 누가 언제 무엇을 말했는지가 바로 나오면, 그 다음엔 요약 에이전트, 검색 인덱스, CRM 태깅, 클립 추천까지 자연스럽게 붙는다. 음성 AI의 진짜 가치는 이제 인식 모델 단품이 아니라, 그 결과가 다음 자동화로 얼마나 매끄럽게 이어지느냐에서 나온다.

그래도 흥분만 하면 안 되는 이유도 분명하다

VibeVoice가 던지는 신호가 크다고 해서 당장 프로덕션 만능 카드로 보면 곤란하다. 공식 README와 Hugging Face 모델 카드도 꽤 솔직하다.

- TTS 계열은 연구 목적 중심으로 안내된다

- 상업/실서비스 적용에는 추가 테스트가 필요하다고 적는다

- 고품질 음성 생성 특성상 딥페이크·사칭 리스크를 강하게 경고한다

- TTS 쪽은 자동 AI 고지 문구와 워터마크 같은 안전장치도 함께 언급한다

이 대목도 오히려 중요하다. 이제 음성 AI 경쟁은 “얼마나 사람처럼 말하느냐”만으로 끝나지 않는다. 누가 더 나은 가드레일과 운영 규칙을 같이 내놓느냐가 시장 신뢰를 좌우한다. 이건 오늘 코딩 에이전트 시장에서 보이는 흐름과도 닮았다. 더 좋은 모델 하나보다, 재사용 가능한 템플릿·툴체인·운영 가드레일이 훨씬 큰 차이를 만든다는 점에서 말이다.

그래서 이 뉴스의 본질은 ‘Whisper 킬러’가 아니라 ‘음성 운영 스택의 재편’이다

나는 VibeVoice를 보면서 “Whisper를 이겼나?”보다 “음성 파이프라인의 어느 레이어를 먹으려 하나?”를 먼저 보게 된다. 그 질문으로 보면 답은 꽤 선명하다. VibeVoice는 장문 처리, 화자 분리, 다국어, 커스텀 핫워드, Transformers 통합, vLLM 지원을 한 묶음으로 내세우면서 오픈소스 음성 AI의 경쟁 축을 모델 단품에서 운영 가능한 스택으로 밀어 올리고 있다.

Whisper 이후 시장은 이제 단순 받아쓰기만으로는 부족하다. 긴 오디오를 덜 자르고, 여러 화자를 덜 잃고, 후속 에이전트가 먹기 좋은 구조로 내보내고, 팀이 직접 fine-tune과 배포를 만질 수 있어야 한다. VibeVoice가 바로 그 방향을 노린다.

내 입장에서

김덕환 운영자가 봤을 때 이 주제는 단순 연구 소식이 아니다. log8.kr 같은 콘텐츠 운영 흐름에서는 인터뷰 정리, 영상 자막, 상담 기록, 음성 검색이 결국 다 한 줄로 연결된다. 그래서 중요한 건 “새 음성 모델이 나왔다”가 아니라, 이걸 우리 콘텐츠·운영 파이프라인에 얼마나 싸게 꽂을 수 있느냐다. 내 눈에는 VibeVoice가 Whisper 이후를 노린다는 말의 뜻이 바로 여기에 있다. 모델 품질 경쟁만이 아니라, 음성 데이터를 재사용 가능한 자산으로 바꾸는 운영 레이어 경쟁이 본격적으로 시작됐다는 뜻이다.