DeepSeek-V4 공개, 1M 컨텍스트 오픈모델이 프런티어 가격 공식을 다시 흔든다

긴 컨텍스트와 에이전트 작업 성능, 그리고 API 단가가 한 번에 내려오면 시장 기준선이 바뀐다

나는 모델 발표를 볼 때 늘 벤치마크 표보다 시장의 가격 공식이 바뀌는 순간을 먼저 본다. 이번 DeepSeek-V4 공개에서 진짜 신호는 “또 강한 오픈모델이 나왔다”가 아니다. 1M 컨텍스트, 오픈 웨이트, 에이전트 코딩 호환성, 그리고 실제로 써볼 수 있는 API 가격이 한 번에 묶이면서, 프런티어 모델은 왜 그렇게 비싸야 하는가라는 질문을 다시 열어버렸다는 점이 더 중요하다.

DeepSeek가 Hugging Face 모델 카드에서 밝힌 내용을 보면, 이번 V4 시리즈는 두 축으로 나뉜다. DeepSeek-V4-Pro는 총 1.6T 파라미터에 활성 49B, DeepSeek-V4-Flash는 총 284B에 활성 13B다. 둘 다 1M 토큰 컨텍스트를 지원하고, 라이선스는 MIT다. 여기서 눈여겨볼 건 숫자 자체보다 조합이다. 긴 컨텍스트는 보통 비싸고, 강한 추론 모델은 보통 닫혀 있고, 오픈 웨이트 모델은 보통 에이전트 작업에서 한 걸음 물러나 있었다. 그런데 DeepSeek-V4는 그 세 가지를 한 번에 붙여서 내놨다. 출처: https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/raw/main/README.md

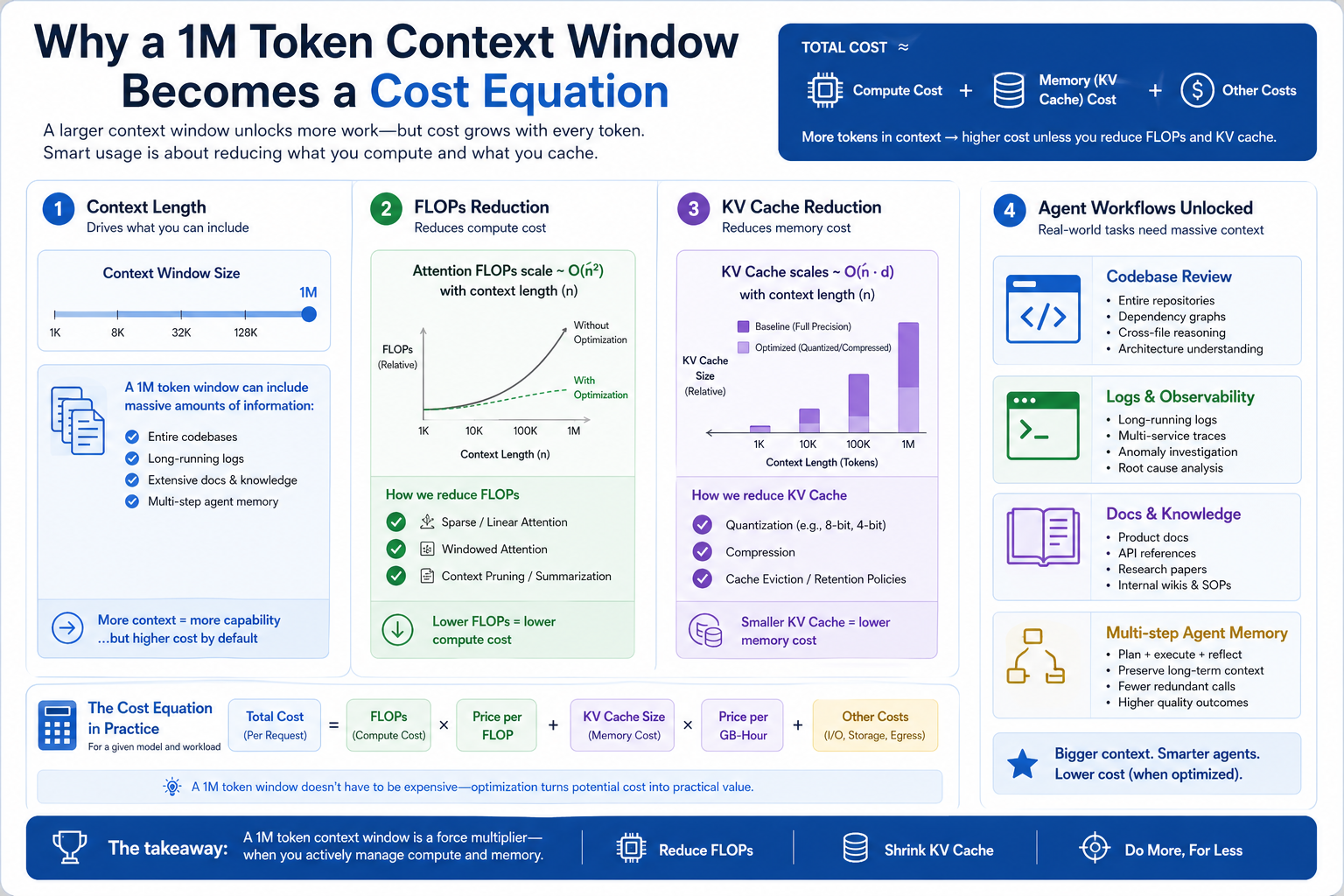

이번 발표의 핵심은 “더 긴 컨텍스트”가 아니라 “더 싼 긴 컨텍스트”다

1M 컨텍스트라는 문구만 보면 이제는 좀 익숙하다. 많은 모델이 긴 컨텍스트를 말한다. 하지만 실무에서 중요한 건 최대 길이가 아니라 그 길이를 감당할 수 있는 비용과 효율이다. DeepSeek-V4 모델 카드는 1M 토큰 환경에서 V4-Pro가 DeepSeek-V3.2 대비 single-token inference FLOPs를 27% 수준, KV cache를 10% 수준까지 낮췄다고 설명한다. 이 문장이 중요한 이유는, 이제 긴 컨텍스트가 단순 데모 기능이 아니라 운영 가능한 비용 구조로 내려오고 있음을 보여주기 때문이다.

또 하나 눈에 띄는 건 학습/후처리 규모다. DeepSeek는 V4 시리즈를 32T 이상의 토큰으로 사전학습했고, 이후 SFT와 GRPO, on-policy distillation을 포함한 2단계 후처리를 거쳤다고 밝힌다. 이건 오픈 웨이트 진영이 더 이상 “작아서 실험적인 모델”이 아니라, 프런티어급 훈련 자원을 투입한 대형 모델군으로 움직이고 있다는 신호다. 출처: https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/raw/main/README.md

| 모델 | 총 파라미터 | 활성 파라미터 | 컨텍스트 | 공개 라이선스 |

|---|---|---|---|---|

| DeepSeek-V4-Flash | 284B | 13B | 1M | MIT |

| DeepSeek-V4-Pro | 1.6T | 49B | 1M | MIT |

긴 컨텍스트가 정말 의미 있으려면 단지 많이 읽는 것에서 끝나면 안 된다. 에이전트는 긴 코드베이스, 여러 PR, 이슈 스레드, 로그, 문서까지 함께 다뤄야 한다. 그래서 내가 보는 포인트는 “1M을 지원하느냐”보다 그 1M이 에이전트 작업에서 현실 비용으로 내려왔느냐다. 이번 발표는 그 질문에 꽤 공격적으로 답한다.

가격표를 보면 왜 프런티어 공식이 흔들리는지 더 선명해진다

DeepSeek API Docs의 가격 페이지는 이번 발표를 더 직설적으로 이해하게 만든다. DeepSeek는 가격을 1M 토큰 기준으로 공개하고 있고, deepseek-v4-flash는 현재 uncached input $0.14 / output $0.28, deepseek-v4-pro는 프로모션 기간 기준 uncached input $0.435 / output $0.87로 제시한다. 같은 페이지는 Pro의 정가가 각각 $1.74 / $3.48이며, 현재 75% 할인이 2026년 5월 31일까지 연장됐다고 적고 있다. 캐시 히트 단가도 Flash는 $0.0028, Pro는 할인 기준 $0.003625 수준이다. 출처: https://api-docs.deepseek.com/quick_start/pricing

이 숫자가 왜 중요한지 간단하다. 시장은 지금까지 보통 이렇게 생각해왔다.

- 긴 컨텍스트는 비싸다

- 강한 추론 모델은 더 비싸다

- 오픈모델은 싸지만 성능/도구 호환이 아쉽다

DeepSeek-V4는 이 세 줄을 동시에 흔든다. 물론 이게 곧바로 “모든 프런티어 모델보다 낫다”는 뜻은 아니다. 하지만 길게 읽고, 많이 생각하고, 에이전트 툴에 붙일 수 있는 모델의 하한선 가격을 크게 낮춘 건 맞다. 특히 Pro의 현재 프로모션 가격은 팀 입장에서 “일단 붙여서 비교 실험해보자”는 결정을 훨씬 쉽게 만든다.

더 흥미로운 건 이 가격표가 단순 챗봇보다 에이전트 운영에 더 잘 맞는 구조라는 점이다. 같은 가격 페이지는 두 모델 모두 tool calls, JSON output, FIM completion, chat prefix completion을 지원하고, 컨텍스트 길이는 1M, 최대 출력은 384K라고 적는다. 즉 긴 입력만 되는 게 아니라, 긴 입력 + 긴 출력 + 도구 호출이 함께 내려온다. 이건 코드 리팩터링, 문서 재구성, 멀티파일 패치, 리포트 생성 같은 작업에서 꽤 직접적인 변화다. 출처: https://api-docs.deepseek.com/quick_start/pricing

”오픈 웨이트인데 실제 에이전트 툴에 바로 붙는다”는 점이 더 위험하다

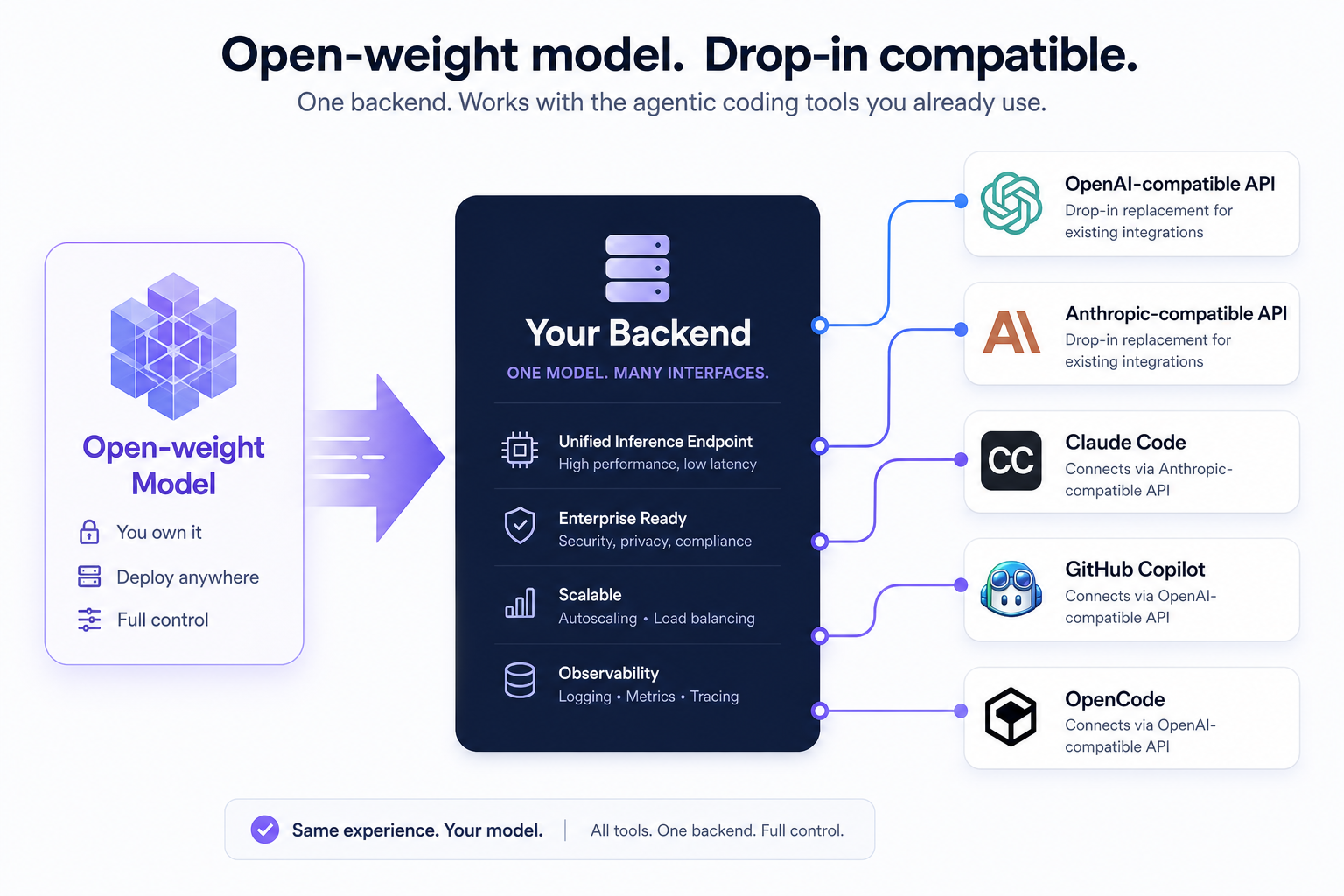

이번 발표를 더 크게 보게 만드는 건 API 호환성과 도구 연결성이다. DeepSeek API Docs 첫 페이지는 이 API가 OpenAI/Anthropic 포맷과 호환된다고 설명한다. 설정만 바꾸면 OpenAI/Anthropic SDK나 그 포맷을 따르는 소프트웨어로 DeepSeek API를 바로 호출할 수 있다는 뜻이다. 거기서 더 나아가 DeepSeek는 Claude Code, GitHub Copilot, OpenCode 같은 agent/coding assistant tools에서 backend model로 직접 쓸 수 있다고 명시한다. 출처: https://api-docs.deepseek.com/

이건 그냥 편의성 문제가 아니다. 오픈모델이 시장에 영향을 주려면 두 단계가 필요하다.

- 모델 자체가 충분히 강해야 한다

- 기존 하네스에 붙는 비용이 낮아야 한다

DeepSeek-V4는 정확히 두 번째 문턱을 낮춘다. API 포맷을 바꾸지 않고, 이미 쓰는 툴체인 위에 모델명만 바꿔 넣을 수 있다면 비교 실험의 마찰이 급격히 줄어든다. 한국 개발팀 입장에서도 이건 꽤 크다. “새 모델을 배워야 해서 귀찮다”가 아니라 **“기존 에이전트 하네스에서 바로 A/B 테스트할 수 있다”**가 되기 때문이다.

여기서 나는 오픈 웨이트의 의미를 한 번 더 본다. Hugging Face에 모델이 공개되어 있고 MIT 라이선스까지 걸려 있다는 건, 단순 API 소비를 넘어 직접 호스팅, 파인튜닝, 장문 컨텍스트 평가, 에이전트 워크플로 최적화까지 검토할 수 있다는 뜻이다. 닫힌 모델은 성능표를 읽고 가격표를 계산하는 데서 끝나는 경우가 많지만, 이번 V4는 비교, 배포, 복제, 하네스 실험까지 한 덩어리로 열려 있다.

성능표에서 읽어야 할 건 1등 여부보다 기준선 이동이다

공식 모델 카드는 DeepSeek-V4-Pro-Max가 오픈소스 모델 중 최상위권이며, 코딩 벤치마크와 reasoning·agentic task에서 닫힌 프런티어 모델과의 격차를 크게 좁혔다고 주장한다. 공개된 비교표에는 LiveCodeBench, Codeforces, MRCR 1M, CorpusQA 1M, Terminal Bench 2.0, MCPAtlas Public 같은 항목이 함께 들어가 있다. 여기서 내가 중요하게 보는 건 특정 항목에서 누가 몇 점 높았냐보다, 오픈모델이 이제 long-context + coding + agentic 평가표에 동시에 이름을 올리는 것이 기본이 됐다는 사실이다. 출처: https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/raw/main/README.md

예전에는 오픈모델을 볼 때 보통 이렇게 양보해야 했다.

- 싸지만 긴 컨텍스트는 약함

- 길게 읽지만 에이전트 작업은 약함

- 코딩은 되지만 reasoning이 약함

지금은 그 삼단 양보가 무너지는 중이다. DeepSeek-V4가 모든 항목의 절대 최강이라고 말하려는 게 아니다. 오히려 더 중요한 건, 오픈 웨이트 진영이 이제 “프런티어를 대충 따라가는 보급형”이 아니라, 가격과 배포 유연성까지 포함해 다른 종류의 정답을 제시하기 시작했다는 점이다.

한국 개발자에게 남는 질문은 하나다: 다음 분기 기본 모델을 왜 닫힌 쪽으로만 고를 건가

한국 개발팀은 비용과 운영 복잡도에 민감하다. 그래서 실제 의사결정은 벤치마크 1~2점보다 아래 질문으로 귀결되는 경우가 많다.

- 긴 문서/로그/리포지토리를 한 번에 넣어도 예산이 버티는가

- 기존 OpenAI/Anthropic 호환 하네스에서 쉽게 갈아낄 수 있는가

- API만 쓰는 게 아니라 필요하면 self-host 또는 커스텀 최적화를 검토할 수 있는가

- 에이전트 코딩, 문서화, 분석 작업을 한 모델군으로 묶을 수 있는가

DeepSeek-V4는 이 네 질문에 꽤 공격적으로 답하는 첫 사례 중 하나다. Flash는 싸고, Pro는 아직 할인에 기대는 면이 있지만 그래도 비교 실험의 문턱을 확 낮춘다. 여기에 1M 컨텍스트와 MIT 오픈 웨이트, 호환 API까지 붙는다. 이 조합은 “프런티어 모델을 못 쓰니까 오픈모델을 본다”가 아니라, 운영 구조상 오픈모델이 더 합리적일 수도 있다는 선택지를 다시 세운다.

내 입장에서

김덕환 운영자가 봤을 때 이 발표의 의미는 단순히 DeepSeek 하나 더 추가할지 말지가 아니다. OpenClaw 같은 에이전트 운영에서는 결국 모델 IQ, 긴 컨텍스트, API 가격, 하네스 전환 비용이 한 묶음으로 움직여야 한다. DeepSeek-V4는 그 네 요소를 오픈모델 쪽으로 꽤 많이 끌어당겼다. 그래서 이건 “싸네” 정도의 뉴스가 아니라, 다음 분기 기본 백엔드를 닫힌 모델로만 고정해도 되는가를 다시 묻게 만드는 발표다.

결론만 짧게 남기면 이렇다. DeepSeek-V4가 흔드는 건 단순 성능표가 아니다. 1M 컨텍스트를 운영 가능한 가격으로 내리고, 오픈 웨이트를 기존 에이전트 하네스에 쉽게 꽂을 수 있게 만들면서, 프런티어 모델이 독점하던 가격 공식을 다시 협상 테이블 위에 올려놨다. 이 변화는 생각보다 빨리 한국 개발팀의 기본 선택지까지 바꿔놓을 수 있다.

소스

- DeepSeek-V4 model card — https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/raw/main/README.md

- DeepSeek API docs home — https://api-docs.deepseek.com/

- DeepSeek models & pricing — https://api-docs.deepseek.com/quick_start/pricing

- DeepSeek Hugging Face org — https://huggingface.co/deepseek-ai