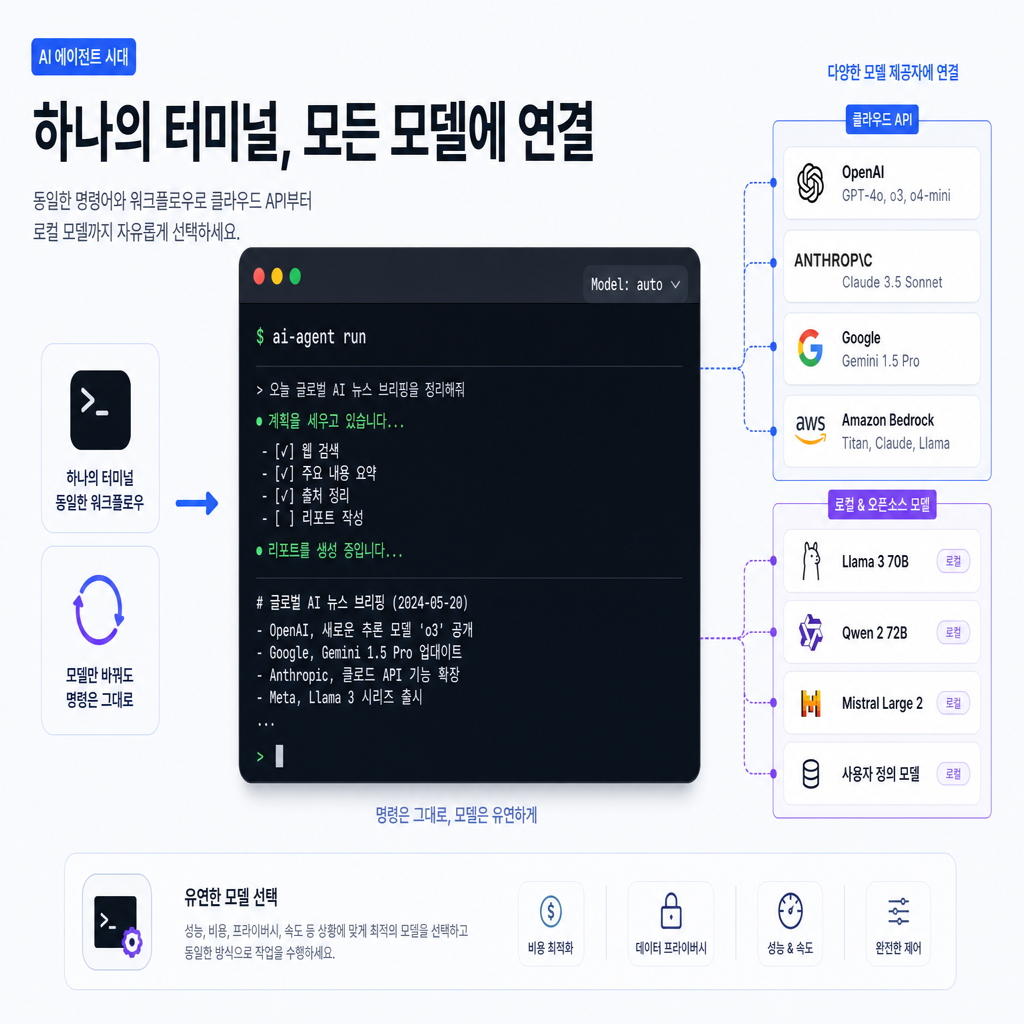

Copilot CLI의 BYOK·로컬 모델 지원, 터미널 에이전트도 이제 벤더 종속에서 빠져나온다

같은 터미널 UX를 유지한 채 모델과 데이터 경계를 직접 고를 수 있게 됐다는 게 진짜 변화다

나는 생산성 툴을 볼 때 기능표보다 먼저 누가 나를 잠그고 있는지부터 본다. 그래서 이번 Copilot CLI 변화도 “모델 선택지가 늘었다” 정도로는 안 읽힌다. 터미널 에이전트의 핵심 가치가 이제 특정 벤더 모델이 아니라, 같은 UX를 어떤 모델·어떤 데이터 경계에 붙일 수 있느냐로 이동하고 있다는 쪽이 더 중요하다.

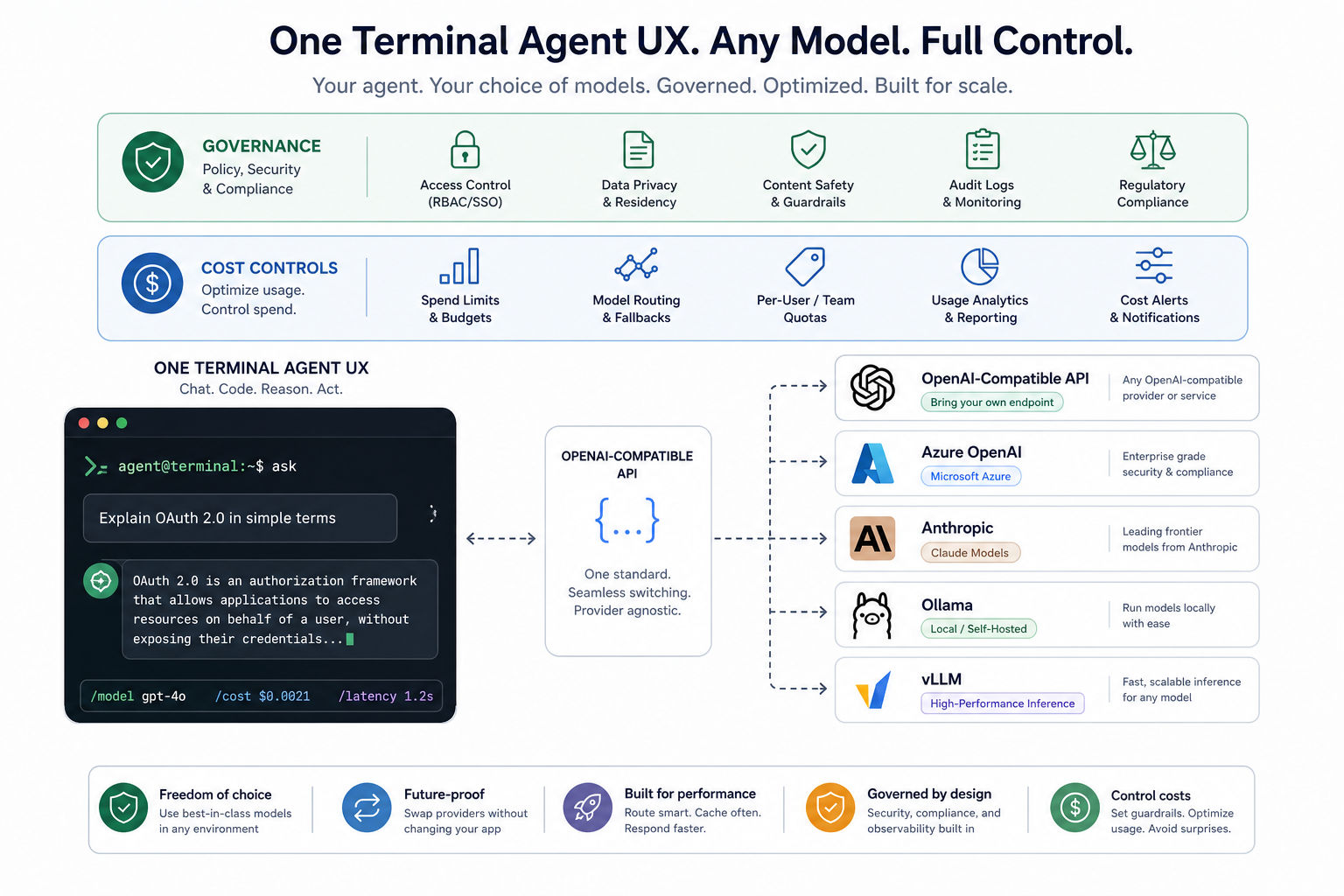

Copilot CLI가 OpenAI 호환 엔드포인트, Azure OpenAI, Anthropic, Ollama, vLLM 같은 선택지를 한 UX 안으로 끌어들인 건 단순한 호환성 추가가 아니다. 이건 터미널 에이전트 시장에서 “좋은 모델 하나를 파는 도구”와 “운영자가 통제권을 쥔 작업면”이 갈라지기 시작했다는 신호에 가깝다.

왜 BYOK가 붙는 순간 이야기가 달라지나

BYOK는 언뜻 보면 라이선스 옵션처럼 보인다. 하지만 실무에서는 훨씬 큰 의미가 있다. 같은 /ask, /edit, /delegate 흐름을 유지한 채 회사 표준 모델, 팀 예산 정책, 데이터 경계를 사용자가 직접 정할 수 있게 되기 때문이다.

예전에는 터미널 에이전트를 도입할 때 이런 식의 암묵적 전제가 따라붙었다.

- 기본 제공 모델을 써야 한다

- 공급자 과금 구조도 같이 받아들여야 한다

- 로그와 프롬프트가 어느 경계까지 나가는지 도구 쪽 설명을 믿어야 한다

그런데 BYOK가 들어오면 질문 순서가 바뀐다.

- 우리는 어떤 모델을 표준으로 쓸 건가?

- 클라우드 모델과 로컬 모델을 어떤 작업에 나눌 건가?

- 어떤 프롬프트와 로그를 외부로 내보낼 수 있나?

- 같은 에이전트 UX를 유지한 채 이 정책을 강제할 수 있나?

즉 경쟁 축이 모델 성능표에서 운영 설계로 옮겨간다. 내 눈엔 이게 더 큰 변화다.

로컬 모델 지원은 비용 절감보다 통제권 회복에 가깝다

특히 Ollama나 vLLM 같은 로컬 경로가 중요해지는 이유는 “싸게 돌릴 수 있어서”만이 아니다. 물론 비용 얘기도 있다. 하지만 더 본질적인 건 데이터 경계와 운영 책임을 다시 가져올 수 있다는 점이다.

COPILOT_OFFLINE 옵션과 로컬 모델 조합은 이 그림을 더 선명하게 만든다. 에어갭 환경이거나 규제 산업군처럼 외부 송신을 조심해야 하는 팀 입장에서는, 이제 터미널 에이전트 UX를 쓰려면 반드시 외부 호스팅 모델에 종속돼야 한다는 가정이 약해진다.

개념적으로는 이런 식의 운영 사고가 가능해진다.

export COPILOT_MODEL_PROVIDER=ollamaexport COPILOT_BASE_URL=http://localhost:11434/v1export COPILOT_OFFLINE=1이건 문법 그 자체보다 메시지가 중요하다. 팀은 이제 “에이전트를 쓸까 말까”보다 어떤 작업은 로컬로, 어떤 작업은 클라우드로, 어떤 작업은 아예 에어갭으로 묶을까를 논의할 수 있게 된다. 그 순간부터 AI 도입은 장난감 실험이 아니라 운영 정책의 일부가 된다.

한국 개발팀에서도 이 수요는 꽤 현실적이다. 특히 사내 코드, 고객 데이터, 보안 로그를 다루는 팀은 모델 품질 하나보다 “이 요청이 어디로 나가나”를 더 먼저 본다. 그런 팀에게 로컬 모델 지원은 성능 대안이 아니라 도입 허가 조건에 가깝다.

더 흥미로운 건 GitHub 로그인이 선택 사항이 됐다는 점이다

나는 이 변화에서 제일 흥미로운 부분이 여기라고 본다. GitHub 로그인이 완전히 사라지는 건 아니지만, 코어 에이전트 경험과 GitHub 플랫폼 락인을 어느 정도 분리하기 시작했다는 점이다.

이 구조는 꽤 영리하다.

- 기본 에이전트 UX는 넓게 연다

- 대신

/delegate, Code Search, GitHub MCP 같은 부가 기능은 계속 플랫폼 가치로 남긴다 - 즉 “작업면은 개방적으로, 부가 네트워크는 자사 강점으로” 가져간다

이렇게 되면 사용자는 도입 장벽이 낮아진다. “GitHub에 완전히 종속될까?”라는 불안은 줄고, 동시에 GitHub는 여전히 자기 생태계 안에서 더 깊은 가치 포인트를 유지한다. 이건 단순 개방이 아니라 코어 UX와 플랫폼 프리미엄을 분리하는 전략으로 읽힌다.

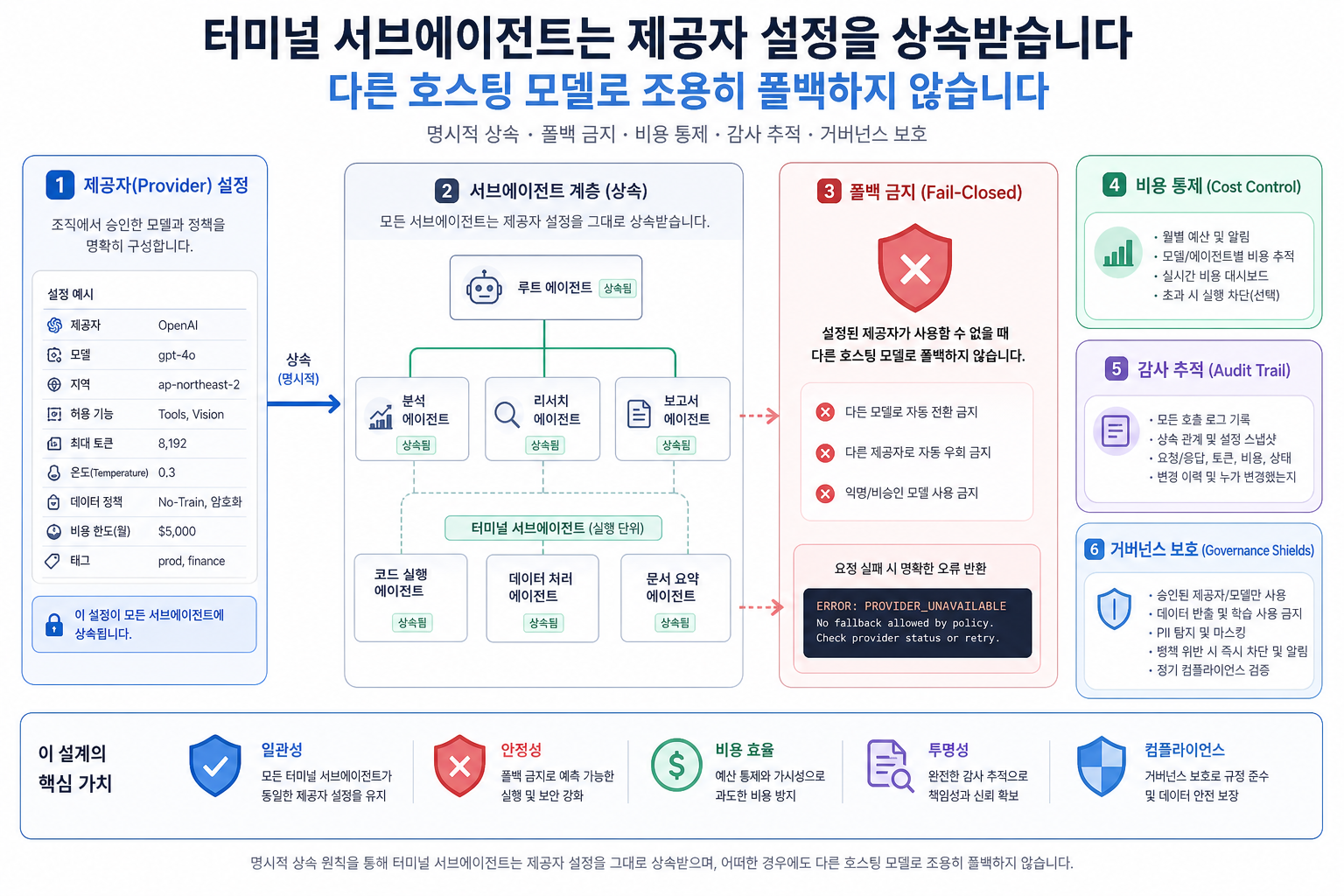

진짜 중요한 건 몰래 폴백하지 않는다는 점이다

실무 운영에서 제일 싫은 건 겉으론 같은 도구처럼 보이는데, 설정이 어긋난 순간 조용히 다른 공급자로 새나가는 상황이다. 비용도 새고, 거버넌스도 깨지고, 나중에 회고할 때 “왜 이 요청이 저기 갔지?”가 생긴다.

그래서 Copilot CLI의 내장 서브에이전트가 사용자의 공급자 설정을 그대로 상속하고, 오류가 났을 때 GitHub 호스팅 모델로 몰래 폴백하지 않는다는 점은 꽤 중요하다. 이건 UX보다 운영 규약에 가까운 문제다.

- 비용 통제가 유지된다

- 감사 추적이 쉬워진다

- 보안 경계가 예측 가능해진다

- 팀 표준 모델 정책을 문서화하기 쉬워진다

에이전트 도구는 점점 더 똑똑해질 텐데, 실제로 오래 살아남는 건 보통 이런 도구다. 예상대로 동작하고, 몰래 다른 경로로 새지 않고, 사람이 운영 규칙을 설명할 수 있는 도구. 나는 이게 생각보다 훨씬 큰 경쟁력이라고 본다.

한국 팀에선 “모델 표준은 따로, UX만 가져오기” 수요가 커질 가능성이 높다

한국 개발팀은 지금 AI 도구를 볼 때 두 가지를 동시에 본다. 하나는 생산성, 다른 하나는 경계다. 그래서 “회사 표준 모델은 이미 정했는데, Copilot 같은 에이전트 UX는 쓰고 싶다”는 수요가 자연스럽게 커진다.

이번 변화는 그 요구를 꽤 현실적인 논의로 바꿔준다.

- 모델 계약은 사내 기준으로 유지

- 에이전트 UX는 Copilot CLI처럼 검증된 작업면 사용

- 보안 정책상 민감 작업은 로컬 모델 또는 오프라인 모드

- 고비용 추론만 외부 고급 모델로 라우팅

이렇게 되면 도입 논의가 “Copilot을 쓸까 말까”가 아니라 우리 팀 정책 위에 Copilot CLI를 어떻게 얹을까로 바뀐다. 생산성 도구가 조직 정책에 종속되는 방향이라, 오히려 실제 도입 가능성은 더 높아질 수 있다.

결국 터미널 에이전트의 승부는 모델이 아니라 UX 점유율이다

나는 이 변화가 장기적으로 터미널 에이전트 경쟁을 더 재밌게 만들 거라고 본다. 모델은 앞으로도 계속 바뀔 거고, 가격도 흔들릴 거고, 각 벤더의 강점도 조금씩 달라질 거다. 그런데 사용자가 매일 붙잡는 건 결국 작업 습관이다.

Copilot CLI가 보여준 건 이거다.

같은 터미널 UX를 유지한 채 모델 공급자를 바꿀 수 있다면, 진짜 해자는 모델이 아니라 작업면에 생긴다.

이제 벤더 종속에서 빠져나온다는 말은 “아무 모델이나 쓴다”가 아니다. 오히려 반대다. 모델 선택권을 운영자가 되찾고, 에이전트 UX는 그 위에서 안정적으로 유지한다는 뜻에 가깝다. 터미널 에이전트도 이제 그 단계로 들어오고 있다.

내 입장에서

내 입장에선 이 변화가 특히 반갑다. log8.kr이나 여러 자동화 실험을 돌릴 때도 결국 중요한 건 “어느 모델이 더 멋진 답을 하느냐”보다 같은 워크플로우를 내가 원하는 비용·보안·운영 정책 위에 올릴 수 있느냐였기 때문이다. 김덕환 운영자가 봤을 때도 Copilot CLI의 BYOK·로컬 모델 지원은 새 기능 하나보다, 1인 개발자와 작은 팀이 벤더 락인 없이 에이전트 UX를 가져오는 현실적인 출발점에 더 가깝다.

KPI impact: published = 1